O que é Computação?

A computação é um campo multidisciplinar que envolve o estudo, desenvolvimento e aplicação de algoritmos e sistemas para processar informação. Em sua essência, a computação busca resolver problemas e otimizar processos através do uso de máquinas e tecnologias computacionais. Desde os primeiros dispositivos mecânicos até os modernos supercomputadores, a computação tem desempenhado um papel vital em quase todos os aspectos da vida contemporânea, estabelecendo-se como uma força impulsionadora nas ciências, na indústria e nas artes.

Em um mundo cada vez mais dependente da tecnologia, a computação contribui de forma significativa para a inovação e a eficiência. Na ciência, por exemplo, a análise de grandes volumes de dados (big data) permite que pesquisadores descubram padrões e façam previsões que eram impossíveis sem o suporte computacional. Já na área da tecnologia, a programação e o design de software estão na base do funcionamento de aplicações que facilitam a interação humana e a automação de tarefas.

No setor empresarial, a computação transforma a dinâmica do mercado. As empresas usam sistemas de informação para gerenciar recursos, melhorar o atendimento ao cliente e tomar decisões fundamentadas. Ferramentas como inteligência artificial e aprendizado de máquina estão revolucionando práticas comerciais, estabelecendo novos padrões de eficiência e produtividade. Além disso, a computação também desempenha um papel relevante nas artes, permitindo que criadores explorem novas formas de expressão através de mídias digitais e interativas.

Portanto, a computação não é apenas um conjunto de técnicas e ferramentas; ela representa uma nova forma de pensar e agir, que afeta diretamente a maneira como vivemos e trabalhamos. Sua importância transcende fronteiras, sendo uma habilidade essencial no mundo moderno, onde a digitalização continua a expandir as possibilidades de inovação e criatividade.

Os Primeiros Passos da Computação

A história da computação remonta a tempos imemoriais, iniciando com métodos rudimentares de contagem e cálculos manuais. Quando os seres humanos começaram a agrupar itens, como grãos ou pedras, para manter registros, surgiram as primeiras formas de computação. Esses métodos de contagem evoluíram com a invenção do ábaco, uma das ferramentas computacionais mais antigas, que permitiu realizar operações matemáticas básicas de forma mais eficiente.

No decorrer dos séculos, vários inventores contribuíram significativamente para o desenvolvimento da computação. Um dos pioneiros foi Blaise Pascal, que, em 1642, criou a Pascalina, uma das primeiras máquinas de calcular mecânicas. Essa invenção possibilitou realizar adições e subtrações com maior facilidade, representando um avanço importante na automação de cálculos. Além disso, Gottfried Wilhelm Leibniz expandiu o conceito de máquinas de calcular com sua máquina, que poderia realizar multiplicações e divisões, apresentando um olhar aprofundado sobre a computação numérica.

Outro marco na evolução da computação veio com Charles Babbage, que projetou o que é conhecido como a “máquina analítica” no século XIX. Este projeto, considerado o precursor dos computadores modernos, incorporava elementos como memória, unidade de controle e capacidade de executar instruções. Embora a máquina de Babbage nunca tenha sido construída completamente em sua época, suas ideias influenciaram gerações posteriores de inventores, incluindo Ada Lovelace, a primeira programadora da história, que reconheceu a monumental importância das instruções computacionais.

Esses primeiros passos da computação, desde as contagens manuais até a concepção de máquinas complexas, formaram a base para a revolução digital que se seguiria. A transição de métodos manuais para máquinas de calcular mecânicas e, posteriormente, eletrônicas, permitiu que a computação evoluísse para o que conhecemos hoje, destacando a importância de seus inventores na trajetória da história da computação.

A Revolução dos Computadores Mecânicos

A história da computação é marcada por importantes inovações que moldaram o desenvolvimento das tecnologias que conhecemos hoje. Um dos períodos mais fascinantes dessa trajetória foi a era das máquinas mecânicas, onde se destacou a figura de Charles Babbage. Ele é frequentemente reconhecido como o “pai da computação” devido às suas ambições para criar dispositivos que pudessem realizar cálculos complexos de forma automática.

A Máquina de Diferenciação, projetada por Babbage na década de 1820, foi uma das suas primeiras inovações. Este dispositivo tinha como objetivo calcular polinômios matemáticos e imprimir resultados em tabelas de maneira precisa. A arquitetura da máquina era composta por componentes mecânicos, como rodas dentadas e alavancas, que trabalhavam em conjunto para realizar operações aritméticas. Embora a Máquina de Diferenciação nunca tenha sido completada em sua forma original, sua concepção introduziu conceitos fundamentais que eventualmente influenciariam os computadores eletrônicos modernos.

Em seguida, Babbage propôs a criação da Máquina Analítica, um design ainda mais ambicioso que visava ser um verdadeiro precursor do computador contemporâneo. A Máquina Analítica incorporava elementos como memória, capacidade para armazenar dados, e um “unidade de controle” capaz de executar instruções, que podem ser comparadas aos modernos processadores. Embora a Máquina Analítica também tenha permanecido inacabada, suas ideias foram revolucionárias, pois introduziram a programação e a lógica computacional muito antes que as tecnologias eletrônicas fossem desenvolvidas.

Essas invenções de Babbage tiveram um impacto profundo, não apenas na matemática e na engenharia, mas também no conceito de máquina como uma extensão da mente humana. Inspiraram gerações posteriores de inventores e engenheiros, criando as bases para a evolução dos computadores e da computação como um campo de estudo disciplinado.

O Advento da Computação Eletrônica

O surgimento dos primeiros computadores eletrônicos marcou um ponto de inflexão significativo na história da computação. Antes do advento dessas máquinas, os processos computacionais eram realizados por equipamentos mecânicos, que, embora eficazes, apresentavam limitações significativas em termos de velocidade e capacidade de processamento. A transição para a computação eletrônica, que teve início na década de 1940, simbolizou uma revolução que transformaria a forma como dados eram gerados, processados e armazenados.

Um dos primeiros exemplos notáveis dessa nova era foi o ENIAC (Electronic Numerical Integrator and Computer), que foi desenvolvido em 1945. Este computador, projetado para cálculos complexos, utilizava válvulas eletrônicas para processar informações, o que proporcionou um aumento exponencial na velocidade de cálculo em comparação com máquinas anteriores. O ENIAC era capaz de realizar complexas operações aritméticas em frações de segundo, um avanço que não só otimiza o tempo necessário para realizar tarefas computacionais, mas também abriu novas possibilidades em diversos campos, como ciências exatas e engenharia.

Outro marco na evolução da computação eletrônica foi o UNIVAC (Universal Automatic Computer), lançado em 1951. O UNIVAC não foi apenas um dos primeiros computadores eletrônicos comercialmente disponíveis, mas também um dos primeiros a oferecer uma interface amigável, permitindo que operadores não especializados pudessem interagir mais facilmente com a máquina. À medida que essas tecnologias evoluíam, a computação passou a ser cada vez mais acessível e aplicável a uma gama mais ampla de setores.

Portanto, o advento da computação eletrônica não apenas revolucionou a velocidade dos cálculos, como também ajudou a estabelecer as bases para o desenvolvimento de sistemas computacionais modernos, culminando na era da informação atual. O impacto desse avanço é palpável, moldando a sociedade contemporânea e influenciando a maneira como vivemos e trabalhamos.

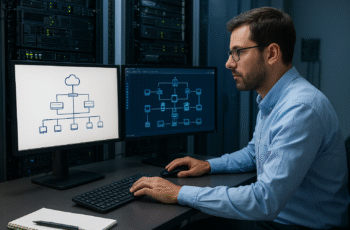

O Desenvolvimento dos Sistemas Operacionais

Os sistemas operacionais (SO) desempenham um papel fundamental na interface entre o usuário e o hardware do computador. Eles gerenciam os recursos do sistema e facilitam a execução de aplicações. A história dos sistemas operacionais remonta aos primórdios da computação, onde máquinas não possuíam um sistema operacional estruturado e eram operadas por comandos diretos, o que exigia um profundo conhecimento técnico por parte do usuário.

Um dos primeiros sistemas operacionais amplamente reconhecidos foi o Disk Operating System, ou DOS, que surgiu na década de 1980. O DOS foi projetado para operar com sistemas de disco e rapidamente se tornou popular devido à sua simplicidade e eficiência. No entanto, sua interface baseada em texto limitava a interação do usuário e a experiência geral. À medida que a computação evoluía, a necessidade de sistemas operacionais mais sofisticados tornou-se evidente.

O Unix, desenvolvido na década de 1970, representou um marco na evolução dos sistemas operacionais. Ele introduziu conceitos inovadores, como multitarefa e permissões de usuário, e tornou-se a base para muitos sistemas modernos. A portabilidade do Unix permitiu sua adaptação a diversas plataformas, influenciando o desenvolvimento de sistemas operacionais subsequentes. Com o crescimento das interfaces gráficas na década de 1990, sistemas como o Windows revolucionaram o acesso dos usuários aos computadores. A interface gráfica do Windows simplificou a interação, permitindo que usuários menos experientes navegassem de forma intuitiva pelo sistema.

Essas transições refletem como os sistemas operacionais moldaram a maneira como interagimos com a tecnologia. De interfaces de linha de comando a ambientes gráficos intuitivos, a evolução dos sistemas operacionais é uma das chaves para a democratização do uso de computadores. Assim, os avanços nos sistemas operacionais não apenas aumentaram a funcionalidade, mas também ampliaram o acesso à computação moderna.

A Era da Computação Pessoal

A década de 1980 marcou um marco significativo na história da computação com a popularização dos computadores pessoais. Inicialmente, a introdução de modelos como o Apple II, em 1977, revolucionou o acesso à tecnologia, mostrando que os computadores não eram apenas para ambientes industriais ou acadêmicos, mas podiam ser incorporados ao cotidiano das pessoas. A Apple desempenhou um papel fundamental, ao lançar dispositivos que eram não apenas funcionais, mas também atraentes e intuitivos, facilitando sua adoção por um público mais amplo.

Simultaneamente, a Microsoft emergiu como uma figura importante nesta era, principalmente com o lançamento do MS-DOS em 1981 e posteriormente do Windows em 1985. O sistema operacional Windows ofereceu uma interface gráfica que, juntamente com o crescimento do hardware disponível, tornou os computadores pessoais ainda mais acessíveis e úteis. Essa combinação de software e hardware possibilitou que pequenas empresas e lares começassem a integrar a tecnologia em suas atividades diárias, redefinindo o modo como as pessoas trabalhavam e se comunicavam.

O aumento da adoção de computadores pessoais teve um impacto profundo na sociedade, transformando a forma como informações eram gerenciadas e compartilhadas. As pequenas empresas passaram a utilizar esses dispositivos para a contabilidade, gestão de estoques e até mesmo na comunicação com clientes e fornecedores, o que resultou em ganhos de eficiência e produtividade. Nos lares, a computação pessoal permitiu o acesso à educação, entretenimento e interação social através da Internet, que começava a ganhar força nesta época. Assim, a era da computação pessoal não apenas espalhou a tecnologia, mas também instituiu novas formas de convivência e uma cultura digital emergente que moldaria o futuro da sociedade.

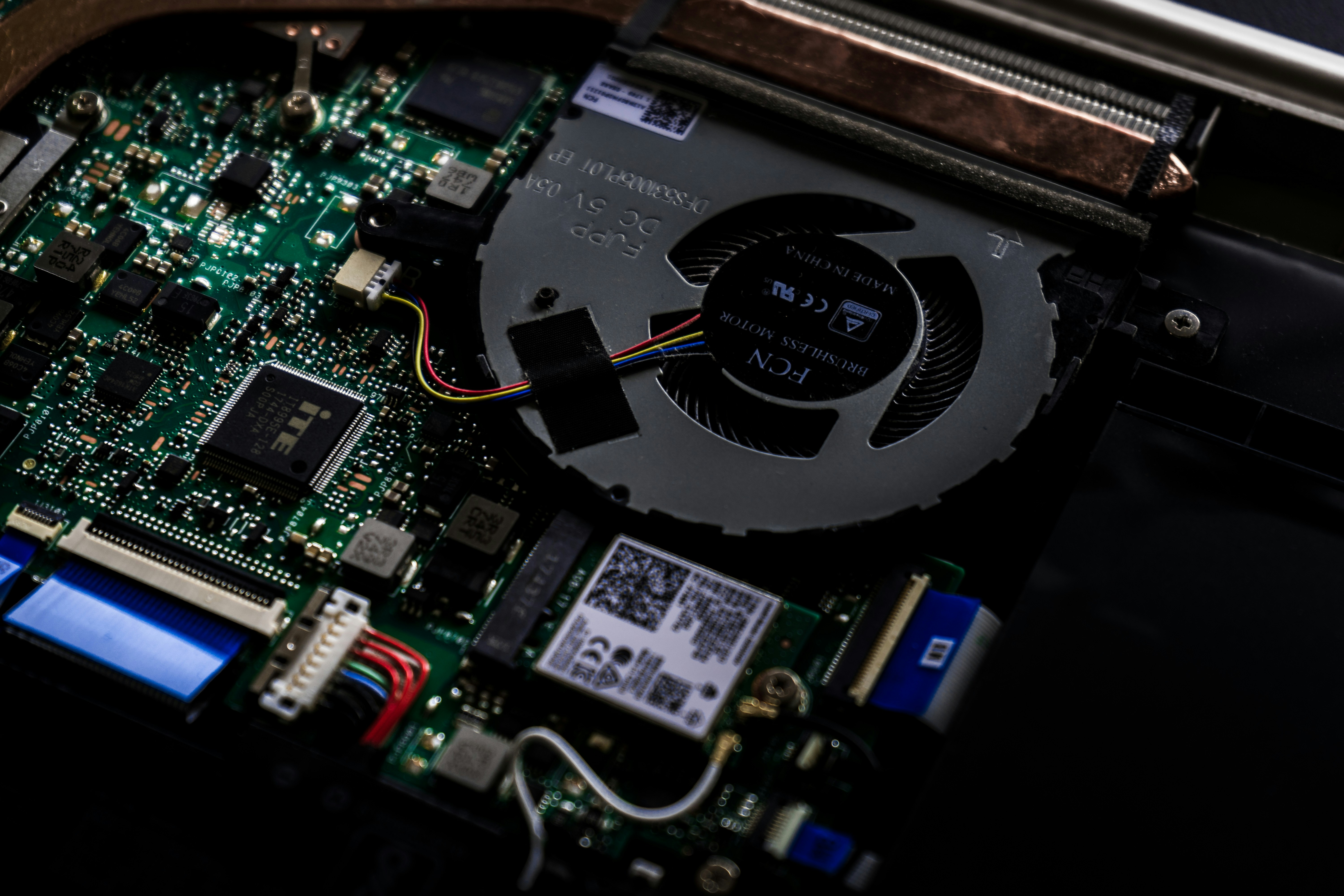

Avanços em Hardware e Software

Nas últimas décadas, o domínio da computação tem sido marcado por avanços significativos em hardware e software, os quais têm sido fundamentais para moldar a tecnologia que utilizamos atualmente. O desenvolvimento de microprocessadores é um dos principais marcos desta evolução. Os microprocessadores modernos, que estão na base de praticamente todos os computadores, evoluíram de simples unidades de processamento de dados para componentes altamente complexos, com múltiplos núcleos e capacidades de processamento paralelas. Esta evolução tem permitido um aumento exponencial da velocidade de processamento, possibilitando que aplicativos e sistemas operacionais realizem tarefas complexas de forma quase instantânea.

Além dos microprocessadores, a evolução da memória também desempenhou um papel crucial nesse cenário. A transição de memória RAM tradicional para formas mais avançadas, como memória flash e unidades de estado sólido (SSD), permitiu uma acessibilidade mais rápida a dados frequentemente utilizados, reduzindo significativamente os tempos de carregamento e melhorando a eficiência geral do sistema. Essa jardinagem na capacidade de armazenamento não só proporciona um desempenho melhor, mas também transforma como os dados são gerenciados e acessados em sistemas modernos.

Por outro lado, o campo das linguagens de programação tem avançado de modo igualmente notável. Linguagens como Python, Java e C++ continuam a evoluir, oferecendo melhores abstrações e maior facilidade no desenvolvimento de software. Essas linguagens não apenas melhoraram a eficiência na programação, mas também ampliaram as oportunidades para a criação de soluções inovadoras em diversas áreas, como inteligência artificial e big data. Cada nova linguagem traz consigo um conjunto de recursos que facilita o trabalho dos desenvolvedores e melhora a interoperabilidade entre diferentes sistemas.

O impacto combinado dos avanços em hardware e software tem sido profundo, culminando em computadores que são não apenas mais rápidos, mas também mais capazes. Essa sinergia tem possibilitado a implementação de tecnologias emergentes, que continuam a mudar a forma como interagimos com o mundo digital.

A Internet e a Revolução Digital

A internet, desde a sua criação, tem desempenhado um papel crucial na transformação da computação e na dinâmica da comunicação global. Nos anos 1960, os primeiros experimentos com redes de computadores estabeleceu a base para o que mais tarde se tornaria a rede mundial que conhecemos hoje. O desenvolvimento do Protocolo de Controle de Transmissão/Protocolo Internet (TCP/IP) nos anos 70 foi um marco fundamental que possibilitou a interconexão de diferentes redes, facilitando a troca de informações de maneira mais eficiente.

Com o advento da World Wide Web em 1991, liderado por Tim Berners-Lee, a acessibilidade à informação disparou, permitindo que usuários comuns interagissem com dados de maneira nunca antes vista. A web expandiu-se rapidamente, catalisando a formação de uma nova era de comunicação, comercio e informação. A partir desse momento, a forma como vivemos e trabalhamos passou a ser radicalmente reformulada. As empresas começaram a perceber o potencial do comércio eletrônico, permitindo que consumidores realizassem compras online, aumentando a conveniência e a variedade disponível para os consumidores, o que foi um impulso importante para a economia digital.

No entanto, não é apenas o comércio que se beneficiou da internet. As redes sociais emergiram como plataformas cruciais para a comunicação, conectando pessoas de diversas partes do mundo e facilitando o compartilhamento instantâneo de informações. Este fenômeno não só transformou a forma como as pessoas interagem, mas também influenciou movimentos sociais e políticos, demonstrando a capacidade da internet de mobilizar comunidades e alterar cenários globais.

Portanto, a evolução da internet e suas inúmeras aplicações têm selado a sua importância na infraestrutura da computação moderna e na sociedade contemporânea, representando uma revolução digital que continua a impactar todos os aspectos da vida cotidiana.

Futuro da Computação

O futuro da computação apresenta um cenário dinâmico, marcado por tendências revolucionárias que têm o potencial de transformar não apenas o campo da tecnologia, mas também a própria sociedade. Entre essas inovações, a inteligência artificial (IA) emerge como uma das mais impactantes. Com a capacidade de aprender e se adaptar de maneira autônoma, a IA está sendo aplicada em setores variados, desde serviços financeiros até saúde e educação. Essa evolução promete otimizar processos, aumentar a eficiência e fornecer soluções personalizadas, mas também levanta questões éticas sobre a privacidade e o controle de dados.

Outro campo revolucionário é a computação quântica, que usa princípios da mecânica quântica para realizar cálculos em velocidades incomparáveis às disponíveis nos computadores tradicionais. Este avanço promete resolver problemas complexos que atualmente desafiam a capacidade computacional convencional, como na pesquisa de novos medicamentos e em algoritmos de segurança cibernética. À medida que essa tecnologia evolui, é crucial que a comunidade científica e a sociedade em geral se preparem para os novos paradigmas que ela poderá instaurar.

Além disso, a Internet das Coisas (IoT) está se consolidando como um componente vital do futuro tecnológico. Com a interconexão de dispositivos do dia a dia, a IoT promete criar ambientes cada vez mais inteligentes, desde casas automatizadas até cidades conectadas. Entretanto, essa interconexão levanta preocupações sobre segurança e privacidade, evidenciando a necessidade urgente de regulações éticas e técnicas adequadas para proteger os usuários. As implicações sociais dessas tecnologias são vastas e podem revolucionar a forma como interagimos com o mundo ao nosso redor, ao mesmo tempo que exigem uma consideração cuidadosa para garantir um futuro inclusivo e seguro.