Compreendendo a Inteligência Artificial e a Ciência de Dados

A Inteligência Artificial (IA) e a Ciência de Dados são áreas interconectadas que desempenham um papel crucial na transformação digital de diversas indústrias. A IA refere-se à capacidade das máquinas de simular processos de inteligência humana, como raciocínio, aprendizado e auto-correção. Por outro lado, a Ciência de Dados envolve a coleta, análise e interpretação de grandes volumes de dados, visando extrair informações valiosas que podem orientar a tomada de decisões. Juntas, essas disciplinas permitem o desenvolvimento de soluções inovadoras e a otimização de processos em setores como saúde, finanças, educação, entre outros.

Os conceitos fundamentais de IA incluem aprendizado de máquina, onde algoritmos são utilizados para que sistemas aprendam com dados disponíveis, e aprendizado profundo, que é uma subcategoria do aprendizado de máquina focada em redes neurais. A Ciência de Dados, por sua vez, abrange técnicas estatísticas, análise exploratória e visualização de dados. A combinação dessas tecnologias resulta em modelos preditivos que podem, por exemplo, prever tendências de mercado ou diagnosticar doenças com precisão.

Para compreender plenamente a interação entre IA e Ciência de Dados, é fundamental reconhecer a importância da qualidade dos dados. Dados limpos e bem estruturados são essenciais para treinar algoritmos de IA eficazes. Além disso, a ética no uso de IA e Ciência de Dados deve ser considerada, especialmente em relação à privacidade dos dados e ao viés algorítmico, que pode impactar diretamente na vida de indivíduos e na sociedade em geral.

Assim, compreender a terminologia básica e os conceitos subjacentes a essas tecnologias é indispensável no contexto atual, onde a IA e a Ciência de Dados estão se tornando cada vez mais prevalentes. Essa compreensão não apenas ajuda a desmistificar as avançadas capacidades dessas ferramentas, mas também capacita profissionais e curiosos a utilizarem essas tecnologias de forma responsável e eficaz.

A Importância da Ética na IA e Ciência de Dados

A ética desempenha um papel fundamental no desenvolvimento e na aplicação de inteligência artificial (IA) e ciência de dados. Com o crescente uso dessas tecnologias em diversas áreas, desde a saúde até a segurança pública, torna-se cada vez mais crítico considerar as implicações éticas associadas a elas. A IA e os sistemas de ciência de dados podem influenciar decisões que afetam a vida das pessoas, e, portanto, é imprescindível que esses sistemas sejam projetados e implementados de uma maneira responsável.

Um dos princípios centrais da ética na IA é a busca por transparência. Os algoritmos que orientam a tomada de decisões devem ser compreensíveis e auditáveis, permitindo que os usuários entendam como e por que determinadas decisões são feitas. Isso é essencial para fomentar a confiança e garantir que os resultados não sejam apenas eficazes, mas também justos. Além disso, a responsabilidade ética envolve a obrigação de proteger dados e garantir a privacidade dos indivíduos, uma questão que tem ganho destaque em face de violações de dados e uso indevido de informações pessoais.

Outro aspecto crítico é a mitigação de preconceitos e discriminação. A ciência de dados é suscetível a viéses presentes nos dados de treinamento, que podem resultar em discriminação, sobretudo em contextos relacionados à raça, gênero ou classe social. Para evitar a perpetuação de preconceitos, é vital que os desenvolvedores realizem avaliações rigorosas sobre os conjuntos de dados e revisem continuamente os algoritmos utilizados. A ética na IA e na ciência de dados exige que os profissionais do campo não apenas considerem os resultados de suas ações, mas também suas consequências sociais e o impacto na comunidade, abrangendo uma responsabilidade mais ampla em sua atuação.

Impacto Social da Inteligência Artificial

A inteligência artificial (IA) tem um impacto profundo na sociedade contemporânea, moldando a forma como interagimos, trabalhamos e vivemos. O emprego de algoritmos de IA em diversos setores, como saúde, educação e segurança, trouxe consigo não apenas inovações, mas também uma série de implicações sociais que demandam análise cuidadosa. Por um lado, a IA pode ser um catalisador para inclusão e acesso à informação. Por exemplo, aplicações baseadas em IA podem ajudar a democratizar o acesso a cuidados médicos, proporcionando diagnósticos mais rápidos e precisos, especialmente em áreas remotas onde recursos médicos são escassos.

No entanto, o uso da inteligência artificial também levanta preocupações significativas, especialmente em relação à privacidade de dados e segurança. Sistemas de vigilância baseados em IA, embora possam ser utilizados para garantir a segurança pública, podem resultar em questões éticas complexas, como a potencial violação de direitos individuais. As tecnologias de reconhecimento facial, por exemplo, têm sido criticadas por seu uso abusivo e por contribuírem para a discriminação racial, levantando preocupações sobre a equidade e a justiça social.

Adicionalmente, a automação impulsionada pela inteligência artificial pode desestabilizar o mercado de trabalho, afetando desproporcionalmente grupos sociais vulneráveis. A substituição de empregos tradicionais por soluções automatizadas pode exacerbar a desigualdade econômica e social, resultando na marginalização de trabalhadores que não têm acesso a formação ou requalificação adequada.

Portanto, ao analisar o impacto social da inteligência artificial, é crucial considerar tanto suas promessas quanto seus desafios. Discutir essas questões é fundamental para garantir que a IA seja utilizada de forma ética e responsável, promovendo um progresso social inclusivo e sustentável.

Desenvolvendo Modelos Éticos de IA

O processo de desenvolvimento de modelos de inteligência artificial (IA) que incorporam princípios éticos é essencial para garantir que essas tecnologias beneficiem a sociedade sem causar danos. Um primeiro passo crucial é a definição clara dos valores e princípios éticos que devem orientar o desenvolvimento do modelo. Isso pode incluir elementos como transparência, justiça, privacidade e responsabilidade. É vital que as equipes envolvidas na criação dos modelos tenham uma compreensão comum e um compromisso firme com esses princípios.

Após a definição dos valores éticos, a próxima etapa envolve o uso de ferramentas e frameworks que ajudam a garantir a incorporação desses princípios nas fases de desenvolvimento. Um exemplo é a aplicação do framework de Fairness, Accountability, and Transparency (FAT), que provê um conjunto de diretrizes práticas para a construção de sistemas mais justos e responsáveis. Ferramentas como o “AIF360” da IBM permitem que os desenvolvedores avaliem e mitigem preconceitos em seus modelos de IA, garantindo que as decisões automatizadas sejam justas e equitativas.

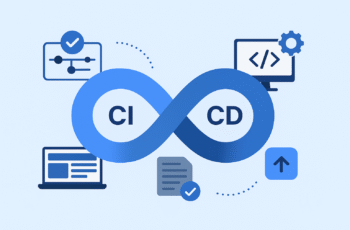

Além disso, a validação contínua dos modelos é fundamental. Esse processo pode incluir a realização de auditorias éticas regulares e a aplicação de métricas específicas para medir o impacto social dos modelos. Os desenvolvedores devem estar preparados para realizar ajustes conforme necessário, garantindo que as soluções não apenas funcionem tecnicamente, mas também respeitem os princípios éticos estabelecidos. Este ciclo de desenvolvimento ético envolve colaboração entre especialistas em diversas áreas, incluindo ética, direitos humanos e ciências sociais, assegurando que múltiplas perspectivas sejam consideradas.

Por fim, a educação e a conscientização sobre ética em IA devem ser promovidas dentro das organizações. Isso pode ser alcançado através de treinamentos regulares e a criação de uma cultura organizacional que valorize a ética como uma dimensão fundamental do desenvolvimento tecnológico.

Exemplo Prático

A aplicação da ciência de dados com foco em ética pode ser ilustrada através de um estudo de caso envolvendo a análise de dados de saúde pública. Neste exemplo, consideraremos um projeto que visa melhorar a prevenção de doenças em uma comunidade específica. O primeiro passo no desenvolvimento deste projeto é a coleta e análise de dados relevantes, garantindo que todas as informações sejam obtidas de forma ética e com o consentimento dos participantes.

Após a coleta de dados, a equipe deve realizar uma depuração cuidadosa, respeitando a privacidade dos indivíduos envolvidos. É vital que as informações sensíveis sejam anonimizadas para proteger a identidade dos participantes. Com os dados prontos, a próxima etapa é a análise estatística, que pode incluir a identificação de padrões ou tendências nas taxas de incidência de doenças. Ferramentas e técnicas de ciência de dados, como algoritmos de aprendizado de máquina, podem ser implementadas para prever surtos e comportamentos da população em relação à saúde.

Uma análise ética também implica em considerar as implicações sociais e os possíveis impactos das decisões tomadas com base nos resultados obtidos. É importante que os cientistas de dados mantenham um diálogo aberto com as partes interessadas, incluindo representantes da comunidade e órgãos reguladores, para assegurar que o conhecimento adquirido seja utilizado de maneira responsável e que beneficie a população.

Por fim, a equipe deve documentar todo o processo, destacando as medidas éticas que foram seguidas e como os resultados serão aplicados para promover a saúde e o bem-estar da comunidade. Este exemplo serve como um alerta para que os leitores, ao realizarem experiências com dados, sempre adotem uma abordagem ética e segura, agindo sob sua própria responsabilidade e respeitando as diretrizes necessárias.

Codificação: Criando um Modelo Ético Simples

A construção de um modelo de inteligência artificial (IA) que respeite princípios éticos e tenha impacto social positivo pode parecer desafiadora, especialmente para iniciantes. No entanto, ao seguir etapas claras e implementar boas práticas, é possível desenvolver um modelo que não apenas cumpra suas funções, mas também considere o bem-estar da sociedade. Aqui, apresentaremos um exemplo simples de um modelo de classificação, utilizando Python e algumas bibliotecas amplamente usadas, como Scikit-learn.

Primeiramente, é essencial coletar dados que sejam representativos e diversos, de forma a evitar viés. A seguir, vamos considerar um conjunto de dados sobre candidatos a um emprego, onde o modelo será utilizado para prever a probabilidade de aceitação com base em atributos como habilidades, experiência e formação.

O código abaixo ilustra um modelo de classificação baseado em uma árvore de decisão. Este modelo é fácil de entender e ensinar, favorecendo a transparência, um aspecto ético vital na implementação de IA.

import pandas as pdfrom sklearn.model_selection import train_test_splitfrom sklearn.tree import DecisionTreeClassifierfrom sklearn.metrics import accuracy_score# Carregar e preparar os dadosdata = pd.read_csv('candidatos.csv')X = data[['habilidades', 'experiencia', 'formacao']]y = data['aceitacao']# Dividir os dados em conjuntos de treino e testeX_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)# Criar e treinar o modelomodelo = DecisionTreeClassifier()modelo.fit(X_train, y_train)# Fazer previsõesy_pred = modelo.predict(X_test)# Avaliar a precisãoprecisao = accuracy_score(y_test, y_pred)print(f'Precisão do modelo: {precisao:.2f}')Este código simples permite que iniciantes compreendam a estrutura básica de um modelo de IA, abordando a importância de dados éticos e representativos, além de mostrar como a transparência pode ser incorporada. Através desse exemplo, espera-se que mais desenvolvedores adotem práticas éticas em seus projetos de IA, promovendo um futuro mais justo e inclusivo.

Fluxograma do Processo de Desenvolvimento

O desenvolvimento de inteligência artificial (IA) e ciência de dados deve seguir um processo estruturado que garanta a consideração de aspectos éticos e de impacto social. Para ajudar na visualização desse processo, um fluxograma pode ser uma ferramenta extremamente útil, pois apresenta cada fase de forma clara e sequencial. O fluxograma geralmente começa com a definição do problema, que é a etapa inicial e crucial. Nesta fase, as equipes de desenvolvimento identificam e clarificam as necessidades que a IA ou a aplicação de ciência de dados deve atender.

A próxima etapa é a coleta de dados. Aqui, são reunidos dados relevantes e de qualidade, considerando também a privacidade e o consentimento dos usuários. Em seguida, faz-se uma análise exploratória dos dados, onde se busca entender as características e distribuições, bem como identificar possíveis viés e lacunas que podem impactar os resultados finais.

A fase seguinte é a modelagem, onde são escolhidos algoritmos apropriados para a tarefa em questão. Deve-se considerar não apenas a eficácia do modelo, mas também como ele poderão impactar diferentes grupos sociais. Após a modelagem, realiza-se o treinamento e validação do modelo, etapas que garantem que o sistema de IA funcione conforme esperado, sem perpetuar desigualdades.

Após validações satisfatórias, a implementação é realizada, levando em conta um monitoramento contínuo. Este monitoramento é essencial para avaliar o desempenho da IA ou do sistema de ciência de dados ao longo do tempo e para ajustar intervenções quando necessário, sempre com um olhar ético em relação ao seu impacto na sociedade. Por fim, a documentação e disseminação dos resultados garantem que as descobertas sejam acessíveis e compreensíveis, contribuindo assim para um desenvolvimento responsável e transparente de tecnologias de IA e ciência de dados que respeitem princípios éticos.

Análise de Dados: Gráficos e Vetores

A representação visual de dados é uma ferramenta poderosa na análise de informações complexas, especialmente quando se trata de abordar questões relacionadas à ética e impacto social. Os gráficos e vetores servem como mecanismos que facilitam a interpretação de dados, permitindo que padrões significativos sejam identificados com maior clareza. Quando utilizamos gráficos, podemos transformar números abstratos em visualizações tangíveis que transmitem uma narrativa. Por exemplo, gráficos de barras são particularmente eficazes para comparar diferentes categorias, enquanto gráficos de dispersão são úteis para observar correlações entre variáveis distintas.

No contexto da ética e do impacto social, é crucial selecionar representações que não apenas informem, mas também proporcionem um entendimento profundo das nuances subjacentes aos dados. A escolha do tipo de gráfico pode influenciar a percepção do público sobre um determinado problema. Um gráfico de linha, por exemplo, pode ilustrar mudanças ao longo do tempo, revelando tendências que podem ser discutidas em termos de suas implicações sociais e éticas. Outras representações, como mapas de calor, podem ser utilizadas para demonstrar a densidade de certos fenômenos em áreas específicas, destacando as necessidades de intervenções sociais.

Além dos gráficos, os vetores desempenham um papel importante na modelagem de dados em um espaço multidimensional. Esses elementos podem ser usados para representar relações complexas de maneira compacta e intuitiva. Eles permitem visualizar interações entre várias variáveis, facilitando a identificação de pontos críticos que requerem atenção. Quando empregados de maneira ética, gráficos e vetores não apenas informam, mas também capacitam os tomadores de decisão a agir de uma maneira que considera as repercussões sociais de suas escolhas, promovendo um abordamento mais consciente e fundamentado em suas intervenções.

Resumo e Considerações Finais

Na era digital contemporânea, a intersecção entre inteligência artificial (IA) e ciência de dados representa não apenas um avanço tecnológico, mas também um desafio significativo no que diz respeito à ética e ao impacto social. Ao longo deste artigo, foram discutidos os principais aspectos que envolvem essas duas áreas, enfatizando a necessidade de uma prática ética na implementação de soluções tecnológicas. A IA, por sua natureza, possui a capacidade de transformar dados em insights valiosos, mas a maneira como esses dados são coletados, analisados e utilizados pode ter consequências profundas para indivíduos e comunidades.

É imperativo garantir que as decisões tomadas por sistemas de IA sejam transparentes e justas, evitando preconceitos que possam ser perpetuados através da análise de dados. A ética na ciência de dados vai além de simples diretrizes; trata-se de uma responsabilidade coletiva de todos os envolvidos na cadeia de desenvolvimento. A conscientização sobre as implicações sociais dessas tecnologias é vital, uma vez que a IA influencia diversas esferas da vida, incluindo saúde, educação e segurança pública.

O impacto social da IA e da ciência de dados é inegável e requer uma abordagem colaborativa que considere as vozes de diferentes stakeholders, incluindo comunidades marginalizadas. A promoção de práticas éticas pode resultar em inovações que não apenas atendem a necessidades técnicas, mas que também respeitam os direitos humanos e promovem a justiça social. Neste contexto, a educação e a formação em ética da tecnologia tornam-se fundamentais, preparando futuras gerações para enfrentar os desafios impostos pela digitalização.

Em resumo, a implementação responsável da inteligência artificial e da ciência de dados pode moldar um futuro mais próspero e igualitário. A ética deve ser um pilar central em todas as iniciativas tecnológicas, ajudando a garantir que os benefícios da IA sejam utilizados para o bem comum, minimizando seus riscos e impactos negativos. Assim, todos têm a oportunidade de contribuir para um desenvolvimento mais sustentável e inclusivo.

Nota Técnica

A discussão sobre inteligência artificial (IA) e ciência de dados é complexa e multifacetada, especialmente quando consideramos o papel da ética e do impacto social. A IA, com suas capacidades de aprendizado de máquina e análise preditiva, desempenha um papel crucial na modificação de diversos setores, como saúde, educação e negócios. No entanto, a implementação dessas tecnologias deve ser feita de forma cuidadosa, considerando os aspectos éticos que envolvem a privacidade e a segurança dos dados.

Um dos conceitos centrais é a responsabilidade ética no uso da IA. A transparência nos algoritmos and processamentos de dados é fundamental para garantir que as decisões automatizadas sejam justas e imparciais. Da mesma forma, é importante discutir a equidade no acesso às tecnologias de IA, uma vez que a desigualdade no uso pode acentuar disparidades sociais existentes.

Além disso, é necessário abordar o conceito de impacto social. As ferramentas de ciência de dados devem ser projetadas com a finalidade de promover o bem-estar coletivo, ao invés de beneficiar apenas grupos específicos. A análise de dados deve ser realizada com a consciência de suas consequências sociais, promovendo a inclusão e minimizando danos. Outro ponto relevante é a importância de integrar múltiplas perspectivas na elaboração de políticas e regulamentos que governam a IA e a ciência de dados. Incluir diversas vozes no processo decisório pode levar a soluções mais robustas e equilibradas.

Em suma, uma abordagem ética e socialmente consciente sobre inteligência artificial e ciência de dados não é apenas desejável; é um requisito fundamental para a construção de um futuro mais justo e equitativo. A reflexão sobre estes conceitos é essencial para todos que atuam nessas áreas, contribuindo para um desenvolvimento que respeite tanto o indivíduo quanto a sociedade em geral.

Pingback: Qualidade e Testes de Software: Garantia da Qualidade de Software