Contexto atual da biometria facial na segurança digital

Atualmente, a biometria facial se consolidou como uma das tecnologias mais utilizadas para autenticação digital, uma vez que combina conveniência, rapidez e uma experiência fluida para o usuário. Além disso, bancos, aplicativos financeiros, redes sociais, governos e empresas privadas adotaram o reconhecimento facial como barreira principal contra acessos não autorizados. Consequentemente, o rosto humano passou a ser tratado como uma “senha viva”, difícil de copiar e teoricamente impossível de falsificar.

Entretanto, com a evolução acelerada da inteligência artificial, surgiram novas ameaças capazes de explorar exatamente os pontos fortes dessa tecnologia. Nesse sentido, os deepfakes transformaram imagens estáticas e vídeos em vetores sofisticados de ataque. Assim, compreender como os hackers usam deepfakes para burlar biometria facial deixou de ser curiosidade técnica e passou a ser uma necessidade estratégica para qualquer pessoa conectada ao mundo digital.

O que são deepfakes e por que eles representam risco real

Antes de tudo, deepfakes são conteúdos audiovisuais gerados ou manipulados por inteligência artificial, capazes de reproduzir rostos, expressões, vozes e movimentos humanos com alto grau de realismo. Além disso, algoritmos baseados em redes neurais profundas aprendem padrões faciais a partir de grandes volumes de dados. Como resultado, o sistema consegue criar representações sintéticas extremamente convincentes.

Portanto, quando esses conteúdos são utilizados de forma maliciosa, tornam-se ferramentas perigosas. Especialmente, ao serem combinados com falhas de implementação em sistemas biométricos, deepfakes podem enganar mecanismos que dependem apenas de análise visual. Logo, o risco não está na tecnologia em si, mas no uso indevido e na falsa sensação de segurança absoluta.

Como funciona a biometria facial na prática

De forma resumida, a biometria facial funciona analisando características únicas do rosto humano, como distância entre olhos, formato do nariz, contorno da mandíbula e textura da pele. Além disso, sistemas modernos utilizam modelos matemáticos para transformar essas características em vetores numéricos. Assim, o rosto deixa de ser apenas uma imagem e passa a ser um conjunto de dados comparáveis.

Por conseguinte, durante a autenticação, o sistema compara o vetor capturado em tempo real com o vetor armazenado anteriormente. Se houver compatibilidade suficiente, o acesso é concedido. Entretanto, se o sistema não possui mecanismos adicionais de verificação de vida, abre-se espaço para ataques sofisticados baseados em deepfakes.

Onde surgem as vulnerabilidades exploradas por hackers

Primeiramente, muitas implementações de biometria facial priorizam usabilidade em detrimento da segurança. Além disso, empresas pressionadas por custos ou prazos acabam adotando soluções simplificadas. Como consequência, mecanismos críticos de detecção de fraude são ignorados ou mal configurados.

Nesse cenário, hackers exploram três pontos principais:

- Ausência de detecção de vivacidade

- Dependência excessiva de imagens 2D

- Falta de análise comportamental

Assim, deepfakes passam despercebidos quando o sistema não consegue diferenciar um rosto real de uma representação sintética altamente realista.

Como os Hackers usam Deepfakes para burlar biometria facial

De maneira estratégica, hackers utilizam deepfakes para simular rostos reais durante processos de autenticação. Além disso, eles alimentam modelos de IA com fotos públicas retiradas de redes sociais, vídeos e transmissões ao vivo. Consequentemente, o algoritmo aprende padrões suficientes para gerar versões artificiais do rosto-alvo.

Em seguida, essas representações são apresentadas ao sistema biométrico como se fossem capturas legítimas. Portanto, quando não há checagem de profundidade, microexpressões ou resposta a estímulos, o sistema aceita o deepfake como verdadeiro. Assim, ocorre a violação do acesso sem necessidade de senhas tradicionais.

Você também pode se interessar por: https://digitalterritory.com.br/domine-a-seguranca-cibernetica-com-programacao-orientada-a-objetos-o-guia-definitivo-para-desenvolvedores-de-elite/

Tabela comparativa: biometria comum x biometria robusta

Para facilitar a compreensão, observe a tabela abaixo:

| Característica | Biometria Facial Simples | Biometria Facial Avançada |

|---|---|---|

| Análise 2D | Sim | Não |

| Detecção de vivacidade | Não | Sim |

| Análise de profundidade | Não | Sim |

| Resistência a deepfakes | Baixa | Alta |

| Uso de IA defensiva | Limitado | Extensivo |

Dessa forma, fica evidente que não é a biometria facial que falha, mas sim a forma como ela é implementada.

Técnicas comuns utilizadas em ataques com deepfakes

Atualmente, os ataques mais comuns envolvem:

- Vídeos sintéticos em tempo real

- Animação de imagens estáticas

- Reutilização de vídeos vazados

- Manipulação de iluminação e ângulo

Além disso, hackers testam múltiplas variações até encontrar o ponto exato em que o sistema falha. Assim, quanto mais simples for a validação biométrica, maior será a superfície de ataque disponível.

EXEMPLO PRÁTICO: simulação educacional de detecção

Para fins exclusivamente educacionais, imagine um sistema que tenta identificar padrões artificiais em imagens faciais. Contudo, antes de prosseguir, leia atentamente o alerta abaixo.

⚠️ ALERTA IMPORTANTE:

O exemplo a seguir é apenas demonstrativo. Qualquer teste deve ser realizado somente em ambientes seguros, controlados e de sua inteira responsabilidade, nunca em sistemas reais, públicos ou de terceiros.

Exemplo em Python (detecção simplificada de padrões artificiais)

import cv2

imagem = cv2.imread("face_teste.jpg", cv2.IMREAD_GRAYSCALE)

laplacian = cv2.Laplacian(imagem, cv2.CV_64F)

variancia = laplacian.var()

if variancia < 50:

print("Possível imagem sintética ou deepfake detectado")

else:

print("Imagem aparenta ser natural")

Assim, esse tipo de lógica ilustra como sistemas defensivos podem identificar padrões anômalos em imagens artificiais. Portanto, o foco está sempre na proteção e não na exploração.

Você também pode se interessar por: https://digitalterritory.com.br/domine-a-seguranca-cybernetica-com-redes-de-computadores-protocolos-e-arquitetura/

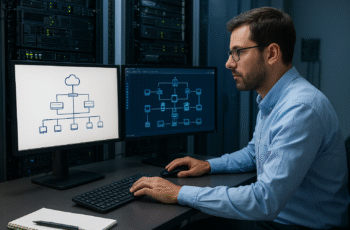

Fluxograma do funcionamento de um ataque com deepfake (visão defensiva)

De forma sequencial, o processo pode ser compreendido assim:

- Coleta de imagens públicas do alvo

- Treinamento de modelo de IA

- Geração de deepfake realista

- Apresentação ao sistema biométrico

- Falha na detecção de vivacidade

- Autenticação indevida

Logo, visualizar esse fluxo ajuda profissionais a identificar exatamente onde reforçar a segurança.

Representação gráfica conceitual (descrição)

Para melhorar a compreensão, imagine os seguintes elementos visuais:

- Gráfico de risco crescente conforme diminui a robustez da biometria

- Vetor representando dados faciais reais versus dados sintéticos

- Camadas de segurança sobrepostas bloqueando o ataque

Assim, esses recursos visuais auxiliam leitores menos técnicos a entenderem a gravidade do problema.

Impactos reais para usuários e empresas

Como resultado, ataques bem-sucedidos com deepfakes geram:

- Fraudes financeiras

- Roubo de identidade

- Danos reputacionais

- Perda de confiança do usuário

Portanto, investir em segurança biométrica avançada deixou de ser opcional. Além disso, a educação do usuário final se tornou parte essencial da estratégia de proteção digital.

Estratégias modernas de defesa contra deepfakes

Atualmente, soluções eficazes incluem:

- Detecção ativa de vivacidade

- Análise tridimensional

- IA treinada para identificar deepfakes

- Monitoramento comportamental contínuo

Assim, a combinação dessas técnicas reduz drasticamente o risco de exploração.

Resumo geral do conteúdo

Em síntese, entender como os hackers usam deepfakes para burlar biometria facial é essencial para navegar com segurança no mundo digital moderno. Além disso, ficou claro que a biometria facial não é falha por natureza, mas exige implementação correta. Portanto, somente com camadas adicionais de proteção é possível enfrentar ameaças cada vez mais sofisticadas. Assim, conhecimento, tecnologia e responsabilidade caminham juntos na defesa digital.

NOTA TÉCNICA:

Deepfake, biometria facial, detecção de vivacidade, inteligência artificial, cibersegurança, fraude digital, reconhecimento facial, autenticação biométrica, segurança digital, IA defensiva